相关资讯

标题:

工具:

简介:

中文提示词:

阿里开源千亿参数模型 Qwen1.5-110B

发布时间:2024-04-28

近期,阿里巴巴对外开源了Qwen1.5系列的1000亿大模型——Qwen1.5-110B语言模型,该模型是该系列迄今为止规模最大之作。

Qwen1.5-110B仍采用Qwen1.5系列惯用的Transformer解码器架构,并创新性集成了分组查询注意力(GQA)机制,这一设计优化了模型在推理阶段的效率。此外,该模型具备处理32K tokens的文本范围能力,保持了多语言特性,广泛支持包括英、中、法、西、德、俄、日、韩、越南语及阿拉伯语在内的多种语言。

通过与当前顶尖的SOTA语言模型Meta-Llama3-70B及Mixtral-8x22B的比较分析,Qwen1.5-110B展现了至少与Llama-3-70B比肩的基础性能水平。

据阿里巴巴透露,在与前代72B模型的对比评估中,Qwen1.5-110B在两个关键的聊天模型基准测试中均显示出显著的性能提升。这一成就强调了一个重要发现:无需根本性改变后续训练策略,仅凭增强基础语言模型的规模与实力,就足以促成聊天模型效能的大幅飞跃。因此,Qwen1.5-110B不仅巩固了其在系列内部的旗舰地位,也进一步验证了大型语言模型对提升应用性能的积极作用。

你可以在魔搭社区 (modelscope.cn) 或Hugging Face镜像站下载。

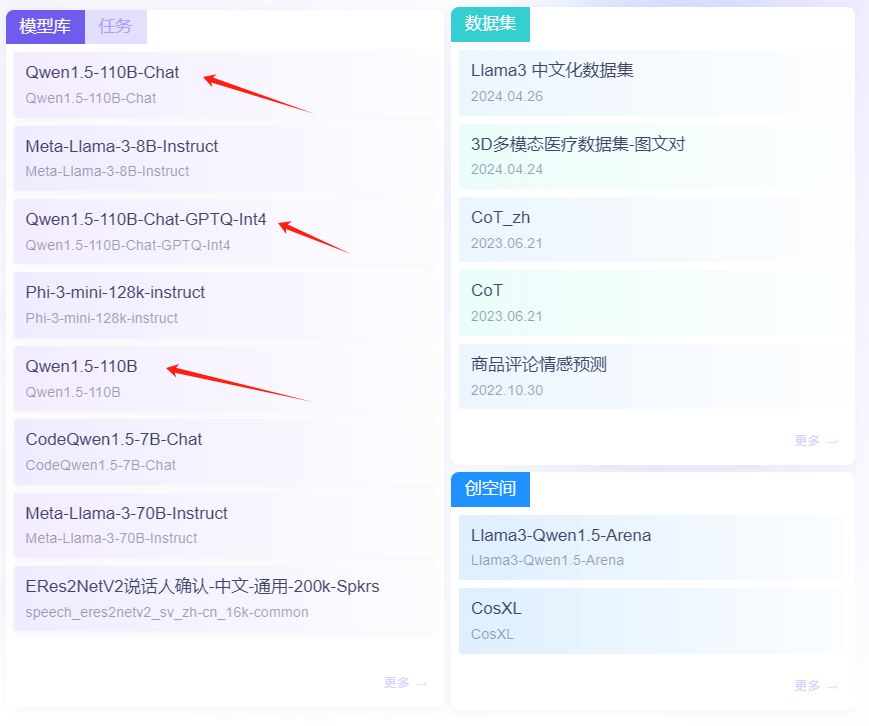

魔搭社区:

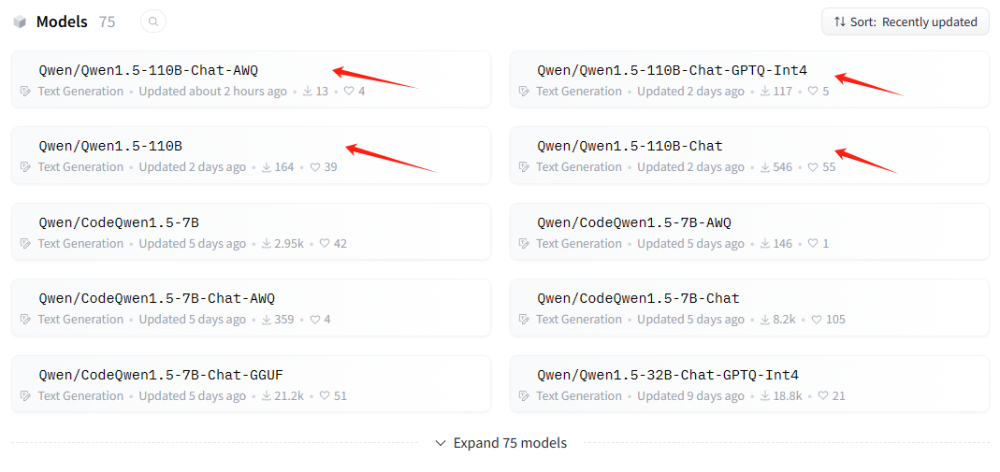

Hugging Face镜像站:

访问次数:95